Zachęcony pytaniem, które pojawiło się na Forum EiS, dotyczącym stosowania różnych efektów w odniesieniu do klipów na jednej ścieżce w programie Reaper, przygotowałem małą lekcję wyjaśniającą ten temat.

Szereg różnych programów DAW oferuje funkcję aplikowania oddzielnych efektów dla pojedynczych klipów znajdujących się na jednej ścieżce (oprócz globalnego efektu dla całej ścieżki). W przypadku Reapera także można skorzystać z tej funkcjonalności, choć trzeba to zrobić trochę „dookoła”. Jednocześnie jednak, Reaper daje interesujące możliwości w zakresie doboru efektów, porównywania różnych wersji z różnymi efektami, co sprzyja kreatywnemu wykorzystaniu tego programu, np. do obróbki pętli czy zaawansowanego przetwarzania kompleksowych nagrań. Poniżej prezentacja tego typu działań. Pokazałem tu wykorzystanie funkcji ujęć (Takes), używając tylko dwóch, ale warto pamiętać, że takich ujęć może być znacznie więcej, każde z innym efektem, co pozwala na dużo bardziej zaawansowane wykorzystanie tej opcji programu.

wideo

Glitchmaszyna za darmo (PC i Mac)

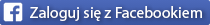

Miłośnicy bardzo intensywnych przekształceń sygnału bazujących na buforowaniu próbek i ich niezależnym przetwarzaniu w domenie czasowej, częstotliwościowej i fazowej z pewnością ucieszą się z faktu, że firma Glitchmachines udostępniła swój piąty bezpłatny produkt pozwalający na tego typu edycję. Mowa o procesorze Fracture, który mimo dość niepozornego wyglądu pozwala uzyskać wyjątkowo interesujące efekty brzmieniowe w stylistyce klikowej i glitch. Wtyczkę (PC i Mac) można pobrać stąd. Nie jest wymagana żadna rejestracja – wkładamy zakup do koszyka i udajemy się do kasy, gdzie od razu można pobrać plik.

Miłośnicy bardzo intensywnych przekształceń sygnału bazujących na buforowaniu próbek i ich niezależnym przetwarzaniu w domenie czasowej, częstotliwościowej i fazowej z pewnością ucieszą się z faktu, że firma Glitchmachines udostępniła swój piąty bezpłatny produkt pozwalający na tego typu edycję. Mowa o procesorze Fracture, który mimo dość niepozornego wyglądu pozwala uzyskać wyjątkowo interesujące efekty brzmieniowe w stylistyce klikowej i glitch. Wtyczkę (PC i Mac) można pobrać stąd. Nie jest wymagana żadna rejestracja – wkładamy zakup do koszyka i udajemy się do kasy, gdzie od razu można pobrać plik.

Dość trudno jednoznacznie opisać, na czym polega działanie tego efektu, ponieważ w dużej mierze zależy ono od materiału wyjściowego. Mamy tu szereg komórek buforujących, wielofunkcyjny filtr, trzy LFO oraz delay, a wszystko to można łączyć w przedziwne kombinacje w celu stworzenia abstrakcyjnych i dynamicznych struktur brzmieniowych.

W poniższym przykładzie zmontowałem niewielki projekt w stylistyce minimal pop. Część ścieżek włączyłem do oddzielnej ścieżki-folderu, na której włączyłem Fracture oraz, na wszelki wypadek, limiter Loudmax. Grupę tę powieliłem, aby uzyskać równoległą obróbkę ścieżek poddanych „glitchowaniu” oraz ścieżek czystych, a niezależnie od nich uruchomiłem dwa ślady ze stopą i pętlami, z których sygnał przekierowałem też do grupy z efektem Fracture. Na całości pracował Loudmax, aby zabezpieczyć się przed dość niebezpiecznymi skokami poziomu wynikającymi z pracy procesora Fracture (który bywa niekiedy nieprzewidywalny). W czasie odtwarzania zmieniałem presety w procesorze, starając się dobierać moment zmian do węzłów aranżacyjnych w mojej mini-kompozycji.

Bezpłatne kursy SpectraLayers

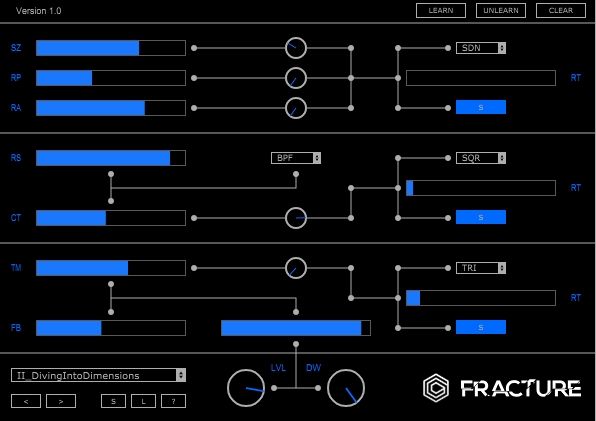

Edycja spektralna materiału audio nie jest zagadnieniem nowym, i kilka firm dość intensywnie zaczęło penetrować ten obszar oprogramowania (iZotope, Adobe, UI Software, Photosounder, Diamond Cut, a nawet Roland). Na ten moment jednak wydaje się, że najbardziej wszechstronnym i funkcjonalnym narzędziem do edycji spektralnej jest Sony SpectraLayers, aktualnie dostępny w wersji 2.1, którą dosłownie przed chwilą otrzymałem do testów, razem z najnowszym Sound Forge Pro Mac 2.0. SpectraLayers 2.1 różni się od wersji 2.0 kilkoma ciekawymi funkcjami, w tym narzędziem do redukcji/eliminacji pogłosu, poprawionym algorytmem redukcji szumów oraz opcją wysyłki odszumionego sygnału na oddzielną warstwę. Trzeba bowiem wiedzieć, że SpectraLayers pracuje na podobnej zasadzie jak Photoshop przy obróbce grafiki bitmapowej – możemy tworzyć różne warstwy, na każdej z nich edytować spektrum sygnału (także z użyciem wtyczek VST), a następnie zgrać całość do postaci pliku audio. SpectraLayers Pro 2.1 doskonale współpracuje z Sound Forge, teraz także z Sound Forge Pro Mac. A jak to wygląda w praktyce, przekonam się za kilka dni, gdy popracuję trochę z nowymi aplikacjami.

Edycja spektralna materiału audio nie jest zagadnieniem nowym, i kilka firm dość intensywnie zaczęło penetrować ten obszar oprogramowania (iZotope, Adobe, UI Software, Photosounder, Diamond Cut, a nawet Roland). Na ten moment jednak wydaje się, że najbardziej wszechstronnym i funkcjonalnym narzędziem do edycji spektralnej jest Sony SpectraLayers, aktualnie dostępny w wersji 2.1, którą dosłownie przed chwilą otrzymałem do testów, razem z najnowszym Sound Forge Pro Mac 2.0. SpectraLayers 2.1 różni się od wersji 2.0 kilkoma ciekawymi funkcjami, w tym narzędziem do redukcji/eliminacji pogłosu, poprawionym algorytmem redukcji szumów oraz opcją wysyłki odszumionego sygnału na oddzielną warstwę. Trzeba bowiem wiedzieć, że SpectraLayers pracuje na podobnej zasadzie jak Photoshop przy obróbce grafiki bitmapowej – możemy tworzyć różne warstwy, na każdej z nich edytować spektrum sygnału (także z użyciem wtyczek VST), a następnie zgrać całość do postaci pliku audio. SpectraLayers Pro 2.1 doskonale współpracuje z Sound Forge, teraz także z Sound Forge Pro Mac. A jak to wygląda w praktyce, przekonam się za kilka dni, gdy popracuję trochę z nowymi aplikacjami.

SpectraLayers otrzymał na właśnie zakończonych targach NAMM nagrodę Editor Choice od redakcji miesięcznika Sound on Sound. Z tej radości firma Sony postanowiła udostępnić zupełnie bezpłatnie komplet materiałów edukacyjnych w formie wideo (łącznie z rejestracjami webinariów), związanych z obsługą tego niesamowitego programu. Gorąco zachęcam wszystkich zainteresowanych tą tematyką do zapoznania się z zawartością tej strony. Można tam znaleźć mnóstwo interesujących informacji i porad na temat SpectraLayers i praktycznego zastosowania tej aplikacji.

Dodam tylko, że autorem SpectraLayers (początkowo Spectral Layers) jest mieszkający we Francji Robin Lobel (rocznik 1984), założyciel firmy Divide Frame, programista związany z rynkiem gier i produkcji filmowych. Stworzony przez niego SpectraLayers znalazł już zastosowanie w takich obrazach jak Men In Black 3, Total Recall, Twilight oraz The Hobbit. Program jest też wykorzystywany przez FBI. Ale to tajemnica…

Separacja wokalu: wreszcie coś działa!

Separacja wokalu z kompletnych utworów, pozwalająca uzyskać niezależne pliki samego wokalu i samej warstwy instrumentalnej, od zawsze była wielkim marzeniem wielu osób. Taki wokal można potem wykorzystać w remiksach, a sam podkład muzyczny np. w karaoke lub do jakichś innych zbożnych celów. Różne firmy z różnym skutkiem podchodziły do tego tematu wielokrotnie, ale mam wrażenie, że wreszcie się komuś to udało. Tym kimś jest firma Audionamix, która specjalizuje się we wszelkiego typu separacjach, mając na swym koncie różnego typu pierwszoligowe produkcje filmowe z Hollywood. Na tegorocznych targach NAMM zaprezentowała ona aplikację o nazwie ADX Trax, której działanie naprawdę robi wrażenie. Aplikacja jest obecnie dostępna tylko dla komputerów Mac, a jej w pełni funkcjonalne, działające przez tydzień demo można ją pobrać ze strony producenta. Cała magia dzieje się w Chmurze, sama aplikacja zainstalowana w komputerze jest tylko klientem serwera, który dokonuje wszystkich działań. Przy sprawnym łączu internetowym (przyda się łącze symetryczne) całość dzieje się bardzo szybko i nie ma podstaw, żeby narzekać. Na początku Trax sam kreśli linię wokalu, którą „wyłowił” w nagraniu, ale my możemy ją dowolnie korygować korzystając z dostępnych narzędzi i podpowiedzi ze strony generatora dźwięku wiodącego. Edycja odbywa się trochę jak w Melodyne. Czym precyzyjniej zdefiniujemy linię wokalu, tym lepsze uzyskamy efekty. Poza tym mamy też opcje redukcji pogłosu, redukcji perkusji w wokalu i szereg innych ciekawych narzędzi. Po 15 minutach pracy, nawet nie zapoznając się z bardziej zaawansowanymi funkcjami tego narzędzia, udało mi się uzyskać takie oto rezultaty.

Separacja wokalu z kompletnych utworów, pozwalająca uzyskać niezależne pliki samego wokalu i samej warstwy instrumentalnej, od zawsze była wielkim marzeniem wielu osób. Taki wokal można potem wykorzystać w remiksach, a sam podkład muzyczny np. w karaoke lub do jakichś innych zbożnych celów. Różne firmy z różnym skutkiem podchodziły do tego tematu wielokrotnie, ale mam wrażenie, że wreszcie się komuś to udało. Tym kimś jest firma Audionamix, która specjalizuje się we wszelkiego typu separacjach, mając na swym koncie różnego typu pierwszoligowe produkcje filmowe z Hollywood. Na tegorocznych targach NAMM zaprezentowała ona aplikację o nazwie ADX Trax, której działanie naprawdę robi wrażenie. Aplikacja jest obecnie dostępna tylko dla komputerów Mac, a jej w pełni funkcjonalne, działające przez tydzień demo można ją pobrać ze strony producenta. Cała magia dzieje się w Chmurze, sama aplikacja zainstalowana w komputerze jest tylko klientem serwera, który dokonuje wszystkich działań. Przy sprawnym łączu internetowym (przyda się łącze symetryczne) całość dzieje się bardzo szybko i nie ma podstaw, żeby narzekać. Na początku Trax sam kreśli linię wokalu, którą „wyłowił” w nagraniu, ale my możemy ją dowolnie korygować korzystając z dostępnych narzędzi i podpowiedzi ze strony generatora dźwięku wiodącego. Edycja odbywa się trochę jak w Melodyne. Czym precyzyjniej zdefiniujemy linię wokalu, tym lepsze uzyskamy efekty. Poza tym mamy też opcje redukcji pogłosu, redukcji perkusji w wokalu i szereg innych ciekawych narzędzi. Po 15 minutach pracy, nawet nie zapoznając się z bardziej zaawansowanymi funkcjami tego narzędzia, udało mi się uzyskać takie oto rezultaty.

Jak słychać, sporo jest jeszcze do zrobienia, ale czym bardziej wgłębiam się w tę aplikację, tym mocniej wierzę, że można uzyskać efekty zapierające dech w piersiach. Tak jak wspomniałem – kluczem do sukcesu jest odpowiednie „wyrysowanie” linii wokalnej w edytorze (lub poprawienie tej, którą automatycznie zdekodował program), aby specjalne filtry wiedziały, co mają filtrować. Chyba zanosi się na sporą rewolucję w tym temacie. Opłata za program jest roczna i zaczyna się od 240 dolarów. Do końca lutego obowiązuje 20-procentowa zniżka.

Nowy system kalibracji i moja (subiektywna) opinia

Szerzy się wśród producentów sprzętu i oprogramowania tendencja do tworzenia nowych, rewolucyjnych systemów kalibracji monitorów w pomieszczeniu odsłuchowym, a przykłady tego typu narzędzi znajdziemy nawet wśród firm z tzw. pierwszej ligi. Na NAMM właśnie pojawił się kolejny taki system stworzony przez łotewską firmę Sonarworks. Idea tego typu systemów jest stosunkowo prosta. W różnych punktach pomieszczenia mierzony jest sygnał wytwarzany przez monitory, a wyniki pomiarów porównywane są z sygnałem wzorcowym. Po porównaniu aplikowane są do sygnału filtry, których zadaniem jest stłumić to, co się za mocno wybija i podbić to, czego jest za mało. Pomiar dokonywany jest w kilku miejscach, aby w ten sposób w pewnym zakresie skompensować różne poziomy poszczególnych fal w różnych miejscach pomieszczenia. I po zaaplikowaniu takiej korekcji już możemy się cieszyć dźwiękiem jak w najlepszych studiach masteringowych. Proste, prawda?

Szerzy się wśród producentów sprzętu i oprogramowania tendencja do tworzenia nowych, rewolucyjnych systemów kalibracji monitorów w pomieszczeniu odsłuchowym, a przykłady tego typu narzędzi znajdziemy nawet wśród firm z tzw. pierwszej ligi. Na NAMM właśnie pojawił się kolejny taki system stworzony przez łotewską firmę Sonarworks. Idea tego typu systemów jest stosunkowo prosta. W różnych punktach pomieszczenia mierzony jest sygnał wytwarzany przez monitory, a wyniki pomiarów porównywane są z sygnałem wzorcowym. Po porównaniu aplikowane są do sygnału filtry, których zadaniem jest stłumić to, co się za mocno wybija i podbić to, czego jest za mało. Pomiar dokonywany jest w kilku miejscach, aby w ten sposób w pewnym zakresie skompensować różne poziomy poszczególnych fal w różnych miejscach pomieszczenia. I po zaaplikowaniu takiej korekcji już możemy się cieszyć dźwiękiem jak w najlepszych studiach masteringowych. Proste, prawda?

Otóż ani trochę. Żaden znany mi system tego typu nie działa w sposób taki, by można było na nim w stu procentach polegać. Owszem, tu i ówdzie pozwala skorygować pewne problemy z odsłuchem, ale jest to proteza, a do tego wyciosana siekierą z kawałka drewna.

Chodzi o to, że zmiany w odsłuchu sygnału w pomieszczeniu, które nie jest dobrze opracowane akustycznie nie odbywają się w domenie częstotliwościowej ale fazowej (czasowej). Powodują je odbicia, które się pojawiają w pomieszczeniu, i na skutek interakcji z sygnałem bezpośrednim są przyczyną kumulowania się bądź odejmowania ciśnień w określonych miejscach pomieszczenia, co skutkuje zmianami w charakterystyce częstotliwościowej. A wyrównywanie tej charakterystyki po stronie źródła to trochę tak, jak leczenie kataru chusteczką do nosa. Źródłowy sygnał o „kłopotliwych” częstotliwościach będzie odpowiednio cichszy i głośniejszy, to prawda, dając subiektywne wrażenie, że ogólna charakterystyka została wyrównana. Ale problem pozostał, ponieważ pomieszczenie się nie zmieniło. W dalszym ciągu będą występować kumulacje i spadki ciśnień w różnych miejscach, tyle tylko, że ich słyszalność jest mniejsza. Pozostają jednak problemy związane ze zmianami fazy. Co więcej, są one pogłębiane przez filtry (dla nadania powagi sprawie zazwyczaj są to filtry z tzw. liniową fazą, czyli nie wprowadzające opóźnień). A tego typu filtry i do tego działające bardzo wąsko i bardzo głęboko, to jedna z najgorszych rzeczy, jaką można do tego typu zadań użyć.

Ale najpierw rzućcie okiem na poniższy filmik. Pokazuję tu zastosowania wąsko działającej filtracji z bardzo dobrego korektora Fab Filter w trybie podbicia i tłumienia w przypadku tzw. zwykłego filtru (zero latency) oraz filtru z liniową fazą. Zwróćcie uwagę co się dzieje z rezonansem.

Jak łatwo można usłyszeć, działaniu ostro strojonych filtrów pasmowych towarzyszy rezonans, czyli wybrzmiewanie częstotliwości jeszcze po zakończeniu trwania sygnału właściwego. Rzecz poniekąd naturalna, bo każdy rezonans to kumulacja energii, która potrzebuje trochę czasu na to, aby się wytracić. O ile jednak w przypadku zwykłych filtrów działających z przesunięciem fazy (opcja zero latency) ów rezonans pojawia się PO zakończeniu dźwięku właściwego, o tyle w przypadku filtrów z liniową fazą (ponieważ działają one z opóźnieniem potrzebnym na przetworzenie sygnału) rezonans ten pojawia się po sygnale właściwym jak i PRZED nim. I to zarówno podczas ekstremalnego podbijania jak i ekstremalnego tłumienia! Pozostaje zatem pytanie: jak tego typu filtry mogą pełnić funkcję naprawczą jeśli chodzi o charakterystykę, skoro bardzo głęboko wpływają na to, co się dzieje z energią dźwięku już po stronie źródła?

Dithering, czyli (nie taka) czarna magia

O przewagach zapisu i edycji dźwięku z rozdzielczością 24-bitową chyba nikogo nie trzeba przekonywać. Wystarczy powiedzieć, że na 1 bit rozdzielczości przypada 6 dB zakresu dynamiki, więc pliki 16-bitowe mogą mieć teoretyczny zakres dynamiki 96 dB, a pliki 24-bitowe już 144 dB. To oznacza, że rozpiętość dynamiczna między najcichszym sygnałem w materiale muzycznym (jest to zazwyczaj poziom szumów własnych wykorzystywanych urządzeń), a maksymalnym nieprzesterowanym sygnałem jest w przypadku tych drugich aż o 48 dB większa. Dzięki temu możemy rejestrować i przetwarzać dźwięk z niższym poziomem bez obawy o utratę jego dynamiki, mając jednocześnie duży zapas dla odpowiedniej prezentacji transjentów. Praca w 24, a nawet 32 bitach daje też więcej swobody na etapie miksowania, ponieważ dostępny zakres dynamiki znacząco przekracza ten sam parametr występujący nawet w najwyższej klasy sprzęcie audio.

O przewagach zapisu i edycji dźwięku z rozdzielczością 24-bitową chyba nikogo nie trzeba przekonywać. Wystarczy powiedzieć, że na 1 bit rozdzielczości przypada 6 dB zakresu dynamiki, więc pliki 16-bitowe mogą mieć teoretyczny zakres dynamiki 96 dB, a pliki 24-bitowe już 144 dB. To oznacza, że rozpiętość dynamiczna między najcichszym sygnałem w materiale muzycznym (jest to zazwyczaj poziom szumów własnych wykorzystywanych urządzeń), a maksymalnym nieprzesterowanym sygnałem jest w przypadku tych drugich aż o 48 dB większa. Dzięki temu możemy rejestrować i przetwarzać dźwięk z niższym poziomem bez obawy o utratę jego dynamiki, mając jednocześnie duży zapas dla odpowiedniej prezentacji transjentów. Praca w 24, a nawet 32 bitach daje też więcej swobody na etapie miksowania, ponieważ dostępny zakres dynamiki znacząco przekracza ten sam parametr występujący nawet w najwyższej klasy sprzęcie audio.

Cóż z tego, kiedy na sam koniec nasza produkcja muzyczna i tak skończy jako plik w rozdzielczości 16-bitowej – czy to jako ścieżka na płycie CD, czy też jako MP3 dostępne w Internecie.

Aby plik produkcyjny, który ma zazwyczaj 24-bitową rozdzielczość, przekształcić do postaci 16-bitowej, trzeba usunąć w poszczególnych słowach bitowych, z których każde opisuje w systemie dwójkowym wartość poszczególnych próbek sygnału, 8 najmłodszych bitów. Najmłodszych, czyli tych, które odpowiadają za najniższe poziomy. Jeżeli je ot tak po prostu usuniemy za pomocą obcinania bitów (truncate), to w sygnale wynikowym braknie informacji o najcichszych składowych. W przypadku głośnych sygnałów będzie to oznaczało nieznaczną zmianę w ich brzmieniu, ale w przypadku tych cichszych, zwłaszcza wybrzmiewających, będzie już wyraźnie słychać zniekształcenia dźwięku.

Dlatego właśnie wymyślono dithering, czyli roztrząsanie, które może przyjmować różne formy. Najprostszą, choć nie uważaną za właściwy dithering, jest zaokrąglanie wartości poszczególnych sampli, które pozwala w pewnym zakresie złagodzić skutki prostego obcinania bitów. Bardziej zaawansowane formy ditheringu polegają na dodaniu specjalnie ukształtowanego szumu o bardzo niskim i zależnym od materiału dźwiękowego poziomie oraz składzie (niejako wplatając go w sygnał), który sumując się z najcichszymi dźwiękami w materiale 24-bitowym sprawia, że jego elementy składowe zostają niejako przeniesione do tych wartości, które nie będą podlegały redukcji bitów albo przesunięte w widmie sygnału poza zakres słyszalny.

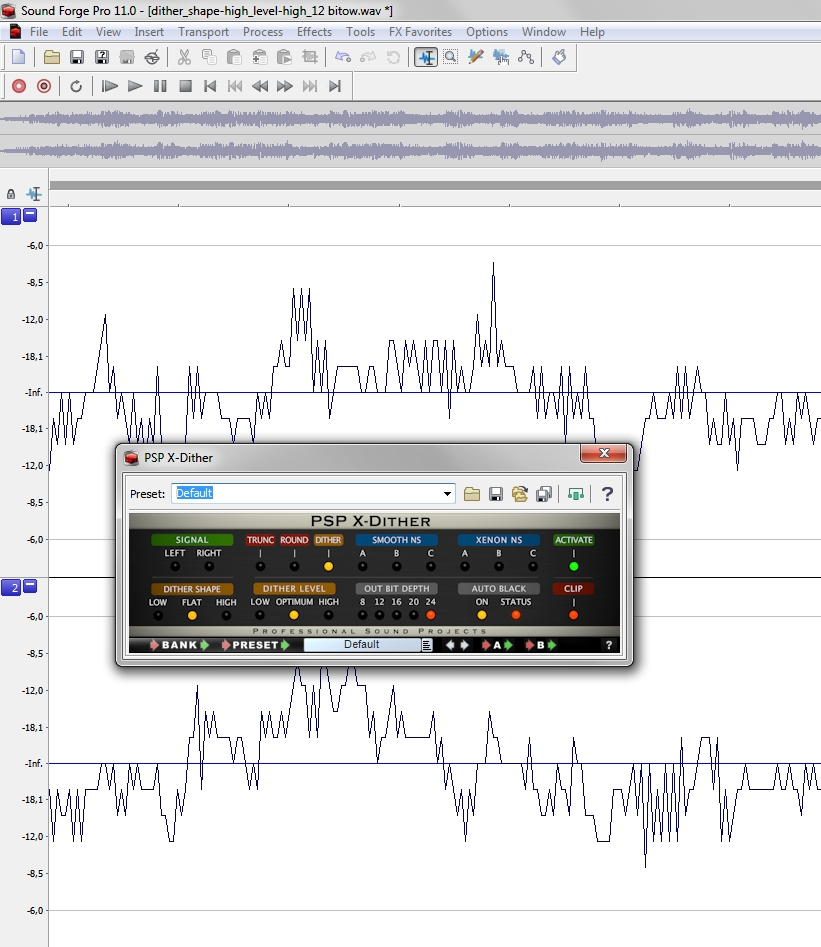

Aby zaprezentować działanie algorytmu ditheringu niemalże jak pod mikroskopem, zmniejszyłem poziom oryginalnego 24-bitowego nagrania o 48 dB, a następnie fragment ten poddałem działaniu procesora PSP X-Dither (test w lutowym numerze magazynu Estrada i Studio) z różnymi ustawieniami, aplikując zmniejszenie rozdzielczości do 12 bitów. Pliki po poddaniu ditheringowi zostały następnie znormalizowane, aby można było lepiej usłyszeć różnice w działaniu algorytmów ditheringu.

Oczywiście w warunkach realnej pracy nikt nie będzie stosował tak skrajnych zabiegów, ale prezentacje te pozwolą lepiej zrozumieć, na czym polega dithering i jakie są efekty jego działania. Zaznaczam raz jeszcze – mamy tu do czynienia z ekstremalną sytuacją i ekstremalnie niekorzystnymi dla brzmienia warunkami. Przy rzeczywistej konwersji bitowej słyszane tu zjawiska odbywają się na poziomie praktycznie niesłyszalnym.

Brute LFO – wykorzystaj iPada w systemie modularnym

Brute LFO to prosta ale bardzo przydatna i nowatorska aplikacja działająca w środowisku iOS, dzięki której możemy sterować dowolnym syntezatorem sprzętowym, posiadającym wejście CV. Brzmi dosyć niewiarygodnie, ale działa i to nawet całkiem sprawnie.

Brute LFO to prosta ale bardzo przydatna i nowatorska aplikacja działająca w środowisku iOS, dzięki której możemy sterować dowolnym syntezatorem sprzętowym, posiadającym wejście CV. Brzmi dosyć niewiarygodnie, ale działa i to nawet całkiem sprawnie.

Brute LFO to generator niskich częstotliwości, który posiada w sumie trzy niezależne oscylatory. Dzięki parametrom dostępnym w głównym oknie aplikacji możemy zmieniać przebieg generowanych przez nie fal (dostępne są przebiegi: kwadratowy, sinusoidalny i piłokształtny), odstrajać i zmieniać fazę oscylatora nr 2 oraz dodatkowo modulować dwa pierwsze oscylatory za pomocą trzeciego. Trzy oscylatory o różnych parametrach i przebiegach fal dają możliwość wykreowania naprawdę interesujących efektów brzmieniowych. Zwłaszcza jeśli dodamy do nich pady dotykowe (czyli swoisty już znak rozpoznawczy wielu iPadowych aplikacji), dzięki którym ruchem jednego palca zmienimy szybkość i natężenie modulacji.

Brute LFO łączy się z zewnętrznymi urządzeniami za pomocą… wyjścia słuchawkowego (o ile nie posiadamy interfejsu audio współpracującego z urządzeniami przenośnymi). Trudno dać wiarę, ale takie połączenie (testowane z syntezatorem Moog Subphatty) rzeczywiście działa i daje całkiem zadowalające rezultaty. W porównaniu do innych (sprzętowych) źródeł modulacji Brute LFO brakuje może trochę mocy (sygnał jest zwyczajnie słabszy), ale aplikacja stanowi całkiem ciekawą propozycję i z pewnością przydać się może jako dodatkowy generator LFO. Zwłaszcza, że kosztuje niecałe 4€.

Poniższy filmik prezentuje działanie aplikacji z syntezatorem Arturia Minibrute.

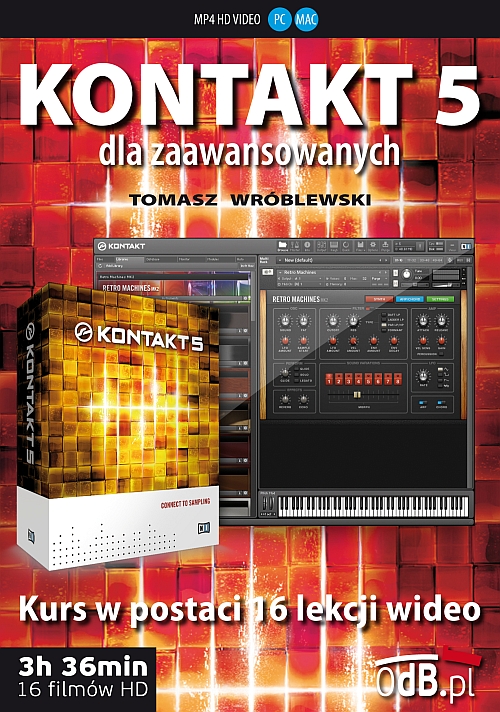

Kontakt 5 dla zaawansowanych

W naszym sklepie dostępna jest już druga część kursu obsługi samplera Kontakt (w sumie razem z pierwszą to prawie 7,5 godziny materiału!). Jest przeznaczona dla osób, które zapoznały się z częścią pierwszą (dla początkujących i średniozaawansowanych), lub korzystają już z tego narzędzia, ale chciałyby do maksimum wykorzystać jego możliwości. W tej części zajmujemy się szczegółowo tworzeniem własnych bibliotek, także z uwzględnieniem wszystkich funkcji automatycznego mapowania, która w Kontakcie została zorganizowana wręcz perfekcyjnie. Opisujemy też najnowsze procesory (bazujące na sprzętowych urządzeniach firm SSL i SPL), dzięki którym wielu twórców może budować w samplerze praktycznie całe aranżacje, uzyskując najwyższej klasy efekty brzmieniowe.

W naszym sklepie dostępna jest już druga część kursu obsługi samplera Kontakt (w sumie razem z pierwszą to prawie 7,5 godziny materiału!). Jest przeznaczona dla osób, które zapoznały się z częścią pierwszą (dla początkujących i średniozaawansowanych), lub korzystają już z tego narzędzia, ale chciałyby do maksimum wykorzystać jego możliwości. W tej części zajmujemy się szczegółowo tworzeniem własnych bibliotek, także z uwzględnieniem wszystkich funkcji automatycznego mapowania, która w Kontakcie została zorganizowana wręcz perfekcyjnie. Opisujemy też najnowsze procesory (bazujące na sprzętowych urządzeniach firm SSL i SPL), dzięki którym wielu twórców może budować w samplerze praktycznie całe aranżacje, uzyskując najwyższej klasy efekty brzmieniowe.

Kontakt ma także bardzo rozbudowane funkcje automatyki i modulacji, potrafiące ożywić nawet najbardziej statyczne próbki i nadać im zupełnie nowy wymiar. Na szczególną uwagę zasługuje możliwość wyjątkowo precyzyjnie działającej ekstrakcji pojedynczych sampli z kompleksowym materiałów muzycznych. Dzięki niej można „wyciągnąć” próbki z gotowych pętli czy fragmentów muzycznych i zbudować z nich całkowicie nową formę. Co więcej – Kontakt umożliwia wykreowanie plików MIDI zawierających strukturę rytmiczną oraz muzyczną przetwarzanego materiału, dzięki czemu można zachować naturalny feeling próbkowanych, granych na żywo partii.

Wszystkie te funkcje, a także dużo więcej, omówiono w drugiej części naszego kompendium. Po jej obejrzeniu będziesz już specjalistą w obsłudze Kontakta i będziesz go mógł w pełni i kreatywnie wykorzystać w swojej pracy.

Kontakt 5 dla zaawansowanych dostępny jest w postaci pliku do pobrania (ok. 1,5 GB spakowane RAR-em), łączny czas trwania kursu to 3h 36 min, a zawiera on 16 filmów w formacie MP4, 1280×720, 44,1kHz/16 bitów. Cena tutorialu to 35 zł.

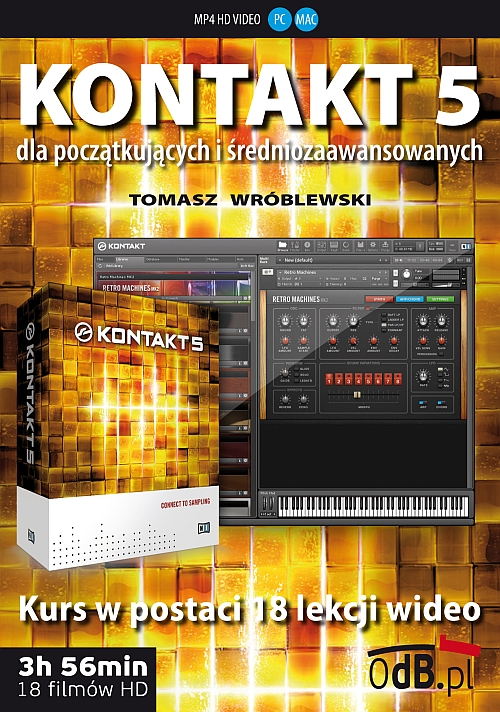

Kontakt 5 dla początkujących i średniozaawansowanych

Z niewielkim poślizgiem, ale już jest. Mowa o najnowszym tutorialu 0dB.pl, którego bohaterem jest Native Instruments Kontakt 5. Cały kurs obsługi tego samplera – głównie z uwagi na jego złożoność oraz mnóstwo funkcji, którymi z początku może wręcz przytłaczać – podzielono na dwie części. Pierwsza jest już dostępna tutaj i można ją zakupić w cenie 30 zł. Jest ona przeznaczona dla osób początkujących i średniozaawansowanych. Jeśli nie miałeś do tej pory do czynienia z Kontaktem, albo używałeś go tylko w zastosowaniach podstawowych, to tutorial ten jest właśnie dla Ciebie. Po jego uważnym obejrzeniu będziesz już mógł swobodnie korzystać z Kontakta 5 w swoich produkcjach, a także tworzyć własne biblioteki z sampli, które sam wykreujesz lub zdobędziesz z innego źródła.

Z niewielkim poślizgiem, ale już jest. Mowa o najnowszym tutorialu 0dB.pl, którego bohaterem jest Native Instruments Kontakt 5. Cały kurs obsługi tego samplera – głównie z uwagi na jego złożoność oraz mnóstwo funkcji, którymi z początku może wręcz przytłaczać – podzielono na dwie części. Pierwsza jest już dostępna tutaj i można ją zakupić w cenie 30 zł. Jest ona przeznaczona dla osób początkujących i średniozaawansowanych. Jeśli nie miałeś do tej pory do czynienia z Kontaktem, albo używałeś go tylko w zastosowaniach podstawowych, to tutorial ten jest właśnie dla Ciebie. Po jego uważnym obejrzeniu będziesz już mógł swobodnie korzystać z Kontakta 5 w swoich produkcjach, a także tworzyć własne biblioteki z sampli, które sam wykreujesz lub zdobędziesz z innego źródła.

Wszystkie funkcje wyjaśnione są bardzo szczegółowo i opatrzone odpowiednim komentarzem, abyś mógł świadomie podejmować decyzje, co do ich stosowania. Pokażemy różne tryby pracy samplera, a także zaprezentujemy ich wszystkie zalety i wady. Jesteśmy pewni, że w którymś momencie powiesz: „dlaczego do tej pory nie korzystałem/am z Kontakta?!”.

Autorem kursu jest Tomasz Wróblewski, łączny czas jego trwania to 4 godziny (bez 4 minut) i zawiera on w sumie 18 filmów w formacie MP4 HD (1280x720i; 25 fps; 16/44,1 kHz). Kurs dostępny jest w wersji do pobrania, w postaci pliku RAR o wielkości 1,4 GB. W opisie kursu zamieszczonym na tej stronie, znajdziesz szczegółowy spis treści poszczególnych lekcji.

Zachętą do obejrzenia tego tutorialu niech będzie informacja, że samplerów programowych (w tym najczęściej właśnie Kontakta 5) używają najbardziej znani kompozytorzy muzyki do filmów, gier i reklam, ponieważ przy odpowiednim ich zastosowaniu można znacząco zredukować koszty produkcji i uczynić ją znacznie łatwiejszą niż przy pracy metodami tradycyjnymi.

Do jakiej muzyki można używać samplera Kontakt 5? Do każdej. Od hip-hopu poprzez pop, rock, absolutnie wszystkie odmiany elektroniki, aż do muzyki ilustracyjnej, akustycznej, a nawet typowo symfonicznej. W przeciwieństwie do syntezatorów, w samplerze nie ma żadnych ograniczeń w tym zakresie. Można też zupełnie zrezygnować z kosztownego, pracochłonnego i czasochłonnego nagrywania instrumentów akustycznych w studiu, mając przy tym znacznie większe możliwości w zakresie kształtowania dźwięku.

Tak, sampler to swoista tajna broń wielu producentów muzycznych. Wiele osób jednak z niego nie korzysta, ponieważ przeraża ich swoją złożonością i nie do końca zrozumiałymi zasadami, jakimi się rządzi praca z nim. Po obejrzeniu naszego kursu będziesz już jednak wiedzieć jak go okiełznać, zmusić do pracy w Twoim środowisku muzycznym i uzyskać znakomite efekty.

Trzy godziny z Paulem

Myślałem, że już nigdy nie uda mi się zobaczyć żadnego Beatlesa w Polsce, a więc gdy tylko dowiedziałem się, że McCartney jednak przyjeżdża, to natychmiast kupiłem bilety. Ceny w pierwszych rzędach były jednak przeraźliwie wysokie, zwłaszcza gdy się chciało z kimś pojechać (wchodziło się już w tysiące złotych!), więc musiałem się zadowolić nieco dalszym sektorem. Takie koncerty śmiało można nazwać wydarzeniem życia: usłyszeć grane na żywo Eight Days a Week, All My Loving, Paperback Writer, The Long and Winding Road, And I Love Her, Your Mother Should Know, Lady Madonna (m.in. z Curie Skłodowską w tle), All Together Now, Eleanor Rigby, Being for the Benefit of Mr. Kite (w końcu piosenka Johna!), doprowadzające do ekstazy, a zaczynające się tak skromnie Something (patrz film niżej), Ob-La-Di, Ob-La-Da, Back in the U.S.S.R. (z napisem Free Pussy Riot – taka mała przeciwwaga: chyba ktoś powiedział Paulowi, że ciągłe wyświetlanie obrazów jak z epoki Stalina w naszym kraju może być kontrowersyjne), Let It Be, Hey Jude (było przecudnie, gdy w trakcie tej piosenki 30 tysięcy ludzi śpiewało i trzymało w rękach białe kartki z napisem Hey Paul), Day Tripper, Lovely Rita, Get Back, Yesterday, Helter Skelter, czy kończącej Abbey Road suity Golden Slumbers/Carry That Weight/The End, to – co tu dużo mówić – coś, co zostaje w człowieku na całe życie. The Beatles zawsze byli dla mnie najważniejsi, od kiedy to jakieś trzydzieści parę lat temu zacząłem świadomie słuchać muzyki. Ich wydawnictwa mam praktycznie w każdej postaci – kilka oryginałów z lat 60., świetnie brzmiące winyle z tłoczeń japońskich, reedycje amerykańskie z lat 70. płyt wydawanych na rynek amerykański, pierwsze kasety z ich piosenkami, nie wspominając już o całej stercie oficjalnych, mniej oficjalnych, nieoficjalnych i całkowicie nielegalnych wersji na CD i w MP3. W mojej bibliotece mam, właśnie policzyłem – 26 książek, w tym takie perełki jak Beatles Gear Babiuka (szczegółowy opis każdego instrumentu i wzmacniacza używanego przez każdego członka zespołu) czy kultową The Recording Sessions Lewisohna (drobiazgowy opis każdej sesji nagraniowej Fab Four), nie wspominając już o tak oczywistych oczywistościach jak Anthology. Większość tych rzeczy przywoziłem przez ostatnie kilkanaście lat z moich podróży zagranicznych, głównie z USA, ale sporo (zwłaszcza oryginalnych winyli) upolowałem we Włoszech, Danii czy Hiszpanii.

Myślałem, że już nigdy nie uda mi się zobaczyć żadnego Beatlesa w Polsce, a więc gdy tylko dowiedziałem się, że McCartney jednak przyjeżdża, to natychmiast kupiłem bilety. Ceny w pierwszych rzędach były jednak przeraźliwie wysokie, zwłaszcza gdy się chciało z kimś pojechać (wchodziło się już w tysiące złotych!), więc musiałem się zadowolić nieco dalszym sektorem. Takie koncerty śmiało można nazwać wydarzeniem życia: usłyszeć grane na żywo Eight Days a Week, All My Loving, Paperback Writer, The Long and Winding Road, And I Love Her, Your Mother Should Know, Lady Madonna (m.in. z Curie Skłodowską w tle), All Together Now, Eleanor Rigby, Being for the Benefit of Mr. Kite (w końcu piosenka Johna!), doprowadzające do ekstazy, a zaczynające się tak skromnie Something (patrz film niżej), Ob-La-Di, Ob-La-Da, Back in the U.S.S.R. (z napisem Free Pussy Riot – taka mała przeciwwaga: chyba ktoś powiedział Paulowi, że ciągłe wyświetlanie obrazów jak z epoki Stalina w naszym kraju może być kontrowersyjne), Let It Be, Hey Jude (było przecudnie, gdy w trakcie tej piosenki 30 tysięcy ludzi śpiewało i trzymało w rękach białe kartki z napisem Hey Paul), Day Tripper, Lovely Rita, Get Back, Yesterday, Helter Skelter, czy kończącej Abbey Road suity Golden Slumbers/Carry That Weight/The End, to – co tu dużo mówić – coś, co zostaje w człowieku na całe życie. The Beatles zawsze byli dla mnie najważniejsi, od kiedy to jakieś trzydzieści parę lat temu zacząłem świadomie słuchać muzyki. Ich wydawnictwa mam praktycznie w każdej postaci – kilka oryginałów z lat 60., świetnie brzmiące winyle z tłoczeń japońskich, reedycje amerykańskie z lat 70. płyt wydawanych na rynek amerykański, pierwsze kasety z ich piosenkami, nie wspominając już o całej stercie oficjalnych, mniej oficjalnych, nieoficjalnych i całkowicie nielegalnych wersji na CD i w MP3. W mojej bibliotece mam, właśnie policzyłem – 26 książek, w tym takie perełki jak Beatles Gear Babiuka (szczegółowy opis każdego instrumentu i wzmacniacza używanego przez każdego członka zespołu) czy kultową The Recording Sessions Lewisohna (drobiazgowy opis każdej sesji nagraniowej Fab Four), nie wspominając już o tak oczywistych oczywistościach jak Anthology. Większość tych rzeczy przywoziłem przez ostatnie kilkanaście lat z moich podróży zagranicznych, głównie z USA, ale sporo (zwłaszcza oryginalnych winyli) upolowałem we Włoszech, Danii czy Hiszpanii.

Prawdziwe znaczenie i wartość tego koncertu, który odbył się 22 czerwca w Warszawie pomału pewnie do mnie dotrze, ale na razie jeszcze jestem w zbyt wielkim szoku po tym przeżyciu… Jedno wiem na pewno – pracowałem jako akustyk na wszelkiego typu dużych koncertach, festiwalach i największych obiektach w kraju przez ładnych parę lat i zwróciłem uwagę, że dźwiękowcy McCartneya zrobili wszystko, żeby przekaz muzyczny choć w części dotarł do ludzi. Prawda jest jednak bolesna. Narodowy kompletnie nie nadaje się do organizacji koncertów w tradycyjnym stylu – nawet z podwójnymi gronami nad sceną i z wieżami dogłaśniającymi dla ludzi w wyższych rzędach na trybunach. Poza tym jeszcze zamknięto dach i dźwięk nie miał gdzie uciec, a pierwsze rzędy były na tyle blisko sceny, że nie można było zrobić kardioidy w odniesieniu do subwooferów (chyba że jakieś były pod sceną, ale ich nie dostrzegłem). W efekcie mieliśmy męczący, przekrzyczany, źle zbalansowany, przytłoczony pogłosem dźwięk, który można było tylko częściowo uratować wypuszczając z głośników 105 dB SPL zmierzone 10 metrów za główną konsoletą (a pracowały ich w sumie trzy).

Ale to nie ma znaczenia. Paul mógłby tylko wyjść i stać na scenie w blasku świateł. Mógłby tylko zagrać Yesterday i Blackbird z gitarą, i to już by wystarczyło. The Beatles, nie w pełnym składzie i pół wieku po szczytowym okresie ich kariery, w końcu przyjechali do Polski. A oni nigdy się nie starzeją i tak naprawdę nigdy od nas nie odchodzą. Byli tu wszyscy czterej – duchem i częściowo ciałem. To było wielkie, naprawdę wielkie przeżycie. Dziękuję Ci Paul za te trzy godziny, dla mnie jedne z najważniejszych.

Czytaj dalej

Koszyk (

Koszyk (